KI-Codegeneratoren: Wie Sprachmodelle Sicherheitslücken in Software einschleusen

Greta Schulz

KI-Codegeneratoren: Wie Sprachmodelle Sicherheitslücken in Software einschleusen

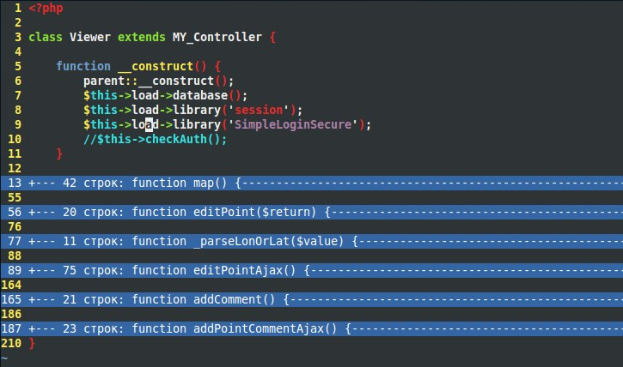

Der Aufstieg großer Sprachmodelle (Large Language Models, LLMs) in der Softwareentwicklung hat eine neue Debatte ausgelöst. Während einige ihre Effizienz loben, warnen andere vor wachsenden Sicherheitsrisiken. Im Mittelpunkt der Bedenken steht nun die Frage, wie diese KI-Tools Schwachstellen in den Code einbringen könnten.

LLMs wie ChatGPT werden zunehmend zur Codegenerierung eingesetzt, doch ihre Fehlerquoten bleiben problematisch. Selbst die fortschrittlichsten Modelle erzeugen in mehr als 5 % der Fälle fehlerhafte Pakete. Diese Ungenauigkeiten, oft als "Halluzinationen" bezeichnet, können Angreifern Tür und Tor öffnen.

Solche falschen Pakete könnten unentdeckt in Projekte gelangen, insbesondere in Umgebungen, die auf Paketmanager angewiesen sind. Werden sie nicht erkannt, könnten sie als Einfallstore für Schadcode dienen. Angreifer könnten diese Schwächen ausnutzen, um Software zu manipulieren oder sensible Daten zu stehlen.

Das Problem rückte in den Fokus, nachdem eine Warnung auf der Plattform PyPI auf böswillige Versionen von LiteLLM hinwies, die darauf ausgelegt waren, Zugangsdaten zu stehlen. Zwar liegen keine spezifischen Studien der USTA zu Gegenmaßnahmen vor, doch laufen branchenweite Bemühungen. Entwickler und Forscher setzen zunehmend strengere Sicherheitsprüfungen und Schulungsprogramme um, um die Risiken zu verringern.

Da immer mehr Unternehmen auf KI-gestützte Entwicklung setzen, bleibt die Sicherheit von Software ein zentrales Thema. Entwickler müssen wachsam bleiben, um die Integrität ihres Codes und externer Bibliotheken zu überprüfen. Die anhaltende Diskussion spiegelt grundlegendere Fragen wider – etwa nach der Rolle der Technologie bei der Gestaltung zukünftiger Industrien.